找到了Gemini和OpenAI的Deep Research的用法:对于一个话题,自动整理资料。对于自己不熟悉的领域,可能是目前最快最可靠的快速学习方法,对于自己熟悉的领域,则是产出更全面更基础内容的“效率工具”。

所以,昨天,关于模型推理性能的问题,把工作分配给了OpenAI,但是“全文翻译”的大梁还是只能交给Gemini完成。

大模型推理性能的完整基础介绍

道明,公众号:数字游牧日常

[Deep Research-3]:讨论一下大模型推理性能吧,再让o3做个“事实核查”

这种结合,我就可以在下面直接讲结论了:

1、对于个人使用的本地部署推理,一般是在笔记本或者PC上,性能不是第一参考因素,只要不是太慢(例如我上周的0.1tokens/s),重要的是模型能力和硬件资源(显卡、显存、内存)的平衡,在可以接受的硬件约束下用最好的模型,是更好的选择:M4 Max的高配Macbook就该使用到70B的模型;

2、对于手机上的本地部署,模型能力是够用原则,在能力够用的前提下,模型规模要尽可能小(2B/3B,甚至1.5B,1B?),但其实这对手机厂商的要求是非常高的。因为体验是时时刻刻可以被感知的,这需要高度结合模型、数据(苹果叫做用户画像的上下文数据)和应用调度的高度融合。到目前为止,我手机上用的高频场景就三个:1、Circle to Search(或者翻译);2、语音识别转录;3、三星Note应用里的手写识别等。这些都是Gemini驱动的,我还在尝试的是GMail的邮件摘要等,但是信息整理总是需要花费一段安静时间的;

3、企业内部本地部署使用,我一直觉得这块业务应该属于私有云服务的:一家企业是很难找到效益最佳点的,用量少了,硬件 and 人力资源闲置,用量大了,硬件资源不够,维护成本飙升。当然,如果都转向私有云了,那更合适的方法应该是租服务而不是算力,按用量付费,迁移方便,内部业绩考核模型最简单;

4、云部署,或者所谓MaaS服务。MaaS不是建或者租个机房,买几台服务器,下载一个“开源模型”(开放权重),提供API调用和计费模块这么简单。或者说,根本很不简单:独家模型、独家硬件、独家优化算法、增值SaaS服务、下游生态,这些要素至少要占一个吧,否则用户为什么要选?当然,还有一个独家,资源,比如便宜的地,便宜的电,或者离用户足够近。但是,核心还是两点:模型能力,打包总成本。

基本就演化出了:

SaaS服务,既卖软件和服务,也打包卖CSP的硬件租赁;

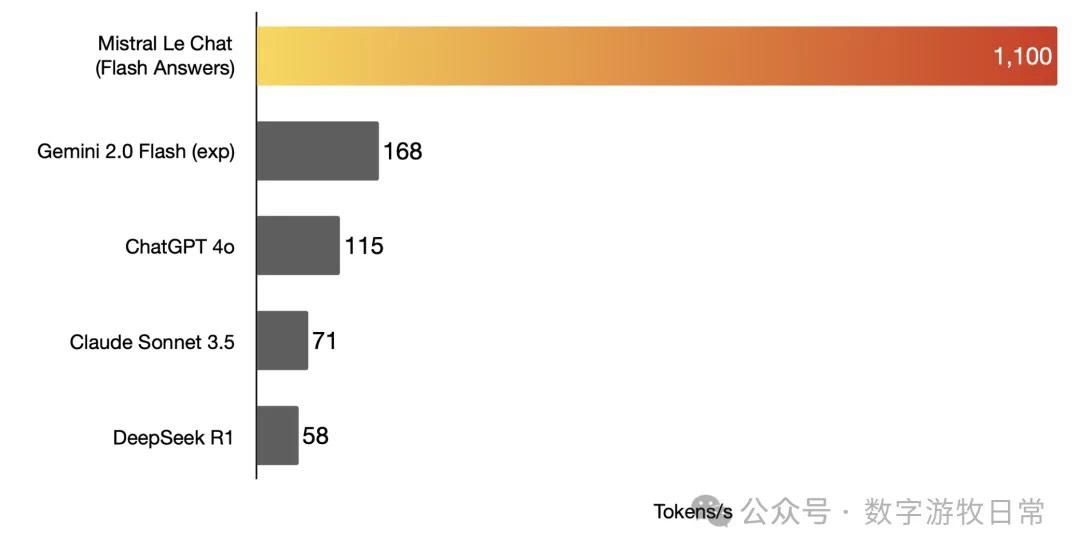

专用推理芯片上的模型调用服务,Groq和Cerebras,基于SRAM的芯片只能自己部署,但就是推理速度奇快,不过如果Transformer被替代了,这些硬件可用性也就大幅降低了;

下游生态带来的API服务,目前看起来Google和三星走的确实最快,虽然都是Gemini驱动,但是三星换了个壳叫Galaxy AI,但是三星不收费,大概是因为Google也没有单独收费吧(除了Gemini Advanced版本),但Google有自己的模型,自己的TPU,自己的生态。当然,也正是因为这点,市场依然对苹果足够期待:更好的生态,自己的芯片与iCloud服务,自己的模型,总会有的,至少够用;

有意思的是,自家芯片与自家模型的结合也是个双刃剑,价格便宜量又足才有用户,才有可持续的商业模式,因为用户大概率不会直接租算力,而是租API服务(哪怕是应用中调用)。很可能,模型不领先了,API服务调用就没了,自家芯片成为“自家负债”,或者自家芯片落后了,推理成本高居不下“劝退用户”;

当然,深度绑定最先进算力,再加上一些增值服务,目前看无论是出租算力,还是直接提供三方模型API服务,似乎还能活一阵子。最重要的还是,头部企业每一代硬件的升级,就能把推理成本降低90%以上,如果这时候数据中心还有一定规模 and 用户量,就可以进一步提升效率,降低成本;

毕竟,如果都是“空手套白狼”,那就看谁成本更低。最先进的算力显然是降本的最大贡献者;其次是数据中心 and 用户规模,规模越大,优化空间越大,成本越低;

点到为止:如果大数据中心的算力利用率都不够,调用成本还过高,那有“三无”小数据中心什么事?

用的越多,亏的越多。

毕竟,离开北上广,过上幸福的“田园生活”,这种例子,只能活在社交媒体里。