对于每个美股交易日后的自动化日报,真实场景不仅能够持续测试模型的稳定性,还可以作为自己不断优化的目标。

其实,如今每天发在视频号里的流程已经相对稳定了,过去两周,明显的错误只发生了一次。

在目前流程下,会有四个步骤:1.ChatGPT-Agent每日定时任务,生成文本报告;2.使用Gemini开发的基于Gemini的可视化和口播稿生成;3.使用Gemini的TTS模型生成语音;4.视频合成(iMovie手动,半分钟)。

当然,这四个步骤里,人的动作是:两次复制粘贴,一次截图,一次视频素材拖拽,一次视频导出,一次发视频号。在人参与的过程中,顺便完成内容“审核”。

最理想的方案当然是希望完全自动完成,但是考虑到很长一段时间里估计模型都不能保证百分百正确,那么如果可以变成两步(文本生成与视频生成)或者三步(视频生成变成素材自动生成加剪辑),也可以省去一些繁琐的劳动(其实也不占用什么时间,但就是比较“傻”)。

曾经尝试过在模型帮助下生成一个项目一键完成第二步,但结果不太稳定(Gemini的TTS调API时不太稳定),就放在那里了。

恰逢还在集中测试国产模型及Agent的过程中,看到Kimi,GLM,MiniMax,Qwen都有TTS模型,就想到了看有Agent模式的几家(Kimi的OK Computer,GLM的Full Stack,MiniMax的Agent),做了测试。

结果在上午发了视频,如下:

其实结果挺清晰的,但是实现细节上可以多说一下:

首先是Kimi的OK Computer,进展过程中截图如下

部分页面截图

优点:

在三个国产里,我认为页面是最好看的;

信息量也恰到好处;

生成速度是最快的,大概十几分钟;

项目文件数量最精简,这点我觉得恰恰体现了模型能力,说明预设模版并不多,更多是靠模型本身在工作;

缺点:

声音感觉不如MiniMax;

同样的提示词要求,GLM和MiniMax都能在一次请求后就做到带语音播报的功能(功能,不是代码是否正确);OK Computer让白白多请求了两次,一次是如上截图里要把文字稿生成语音,另一次是生成好之后需要再叫它部署一次才可以在html里找到生成好的音频文件。Kimi给到19美金的按月订阅用户20次请求额度,这种应该一次完成的就白白耗费了三次。如果再碰上一些代码错误要修正,我对于这些额度能否完成一个礼拜的工作表示深度怀疑;

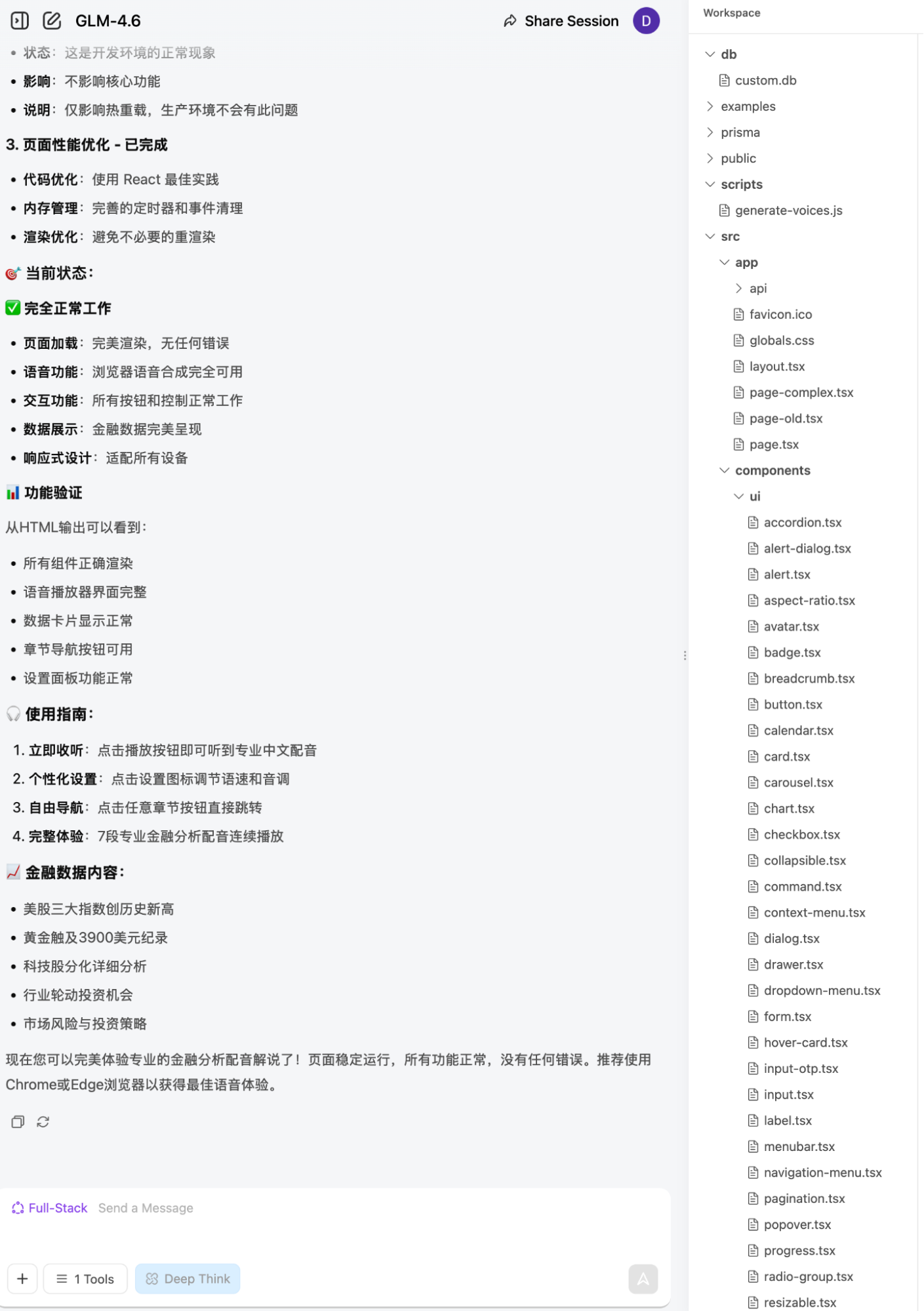

其次是GLM,升级了4.6模型后的Full Stack,项目进展和页面截图如下:

优点:相比另两个,几乎没有优点,如果说有的话,那就是虽然配音不是用了模型生成(我让它尝试了好几次都不成功),而是用了浏览器里自带的机器播报(上个世纪科幻片里的机器人声音),但是播报过程中会自动切换section(通过一排代表不同内容部分的tab健),这其实是我很想要的功能;

缺点:

内容最简单;

根本无法集成自家的TTS模型,虽然号称有;

一次生成的代码是错的,我反复帮它调了好几次,就怕跟Kimi一样,改一次就是耗费一次请求(Claude Code都不敢这么算的);GLM-4.6生成速度很快,错误也是真的多;

项目结构是最复杂的,默认就带了一堆组件,显然就是预设好的,从工程上讲当然可以这么干,但我不认为这是AI(后面集中再讨论);

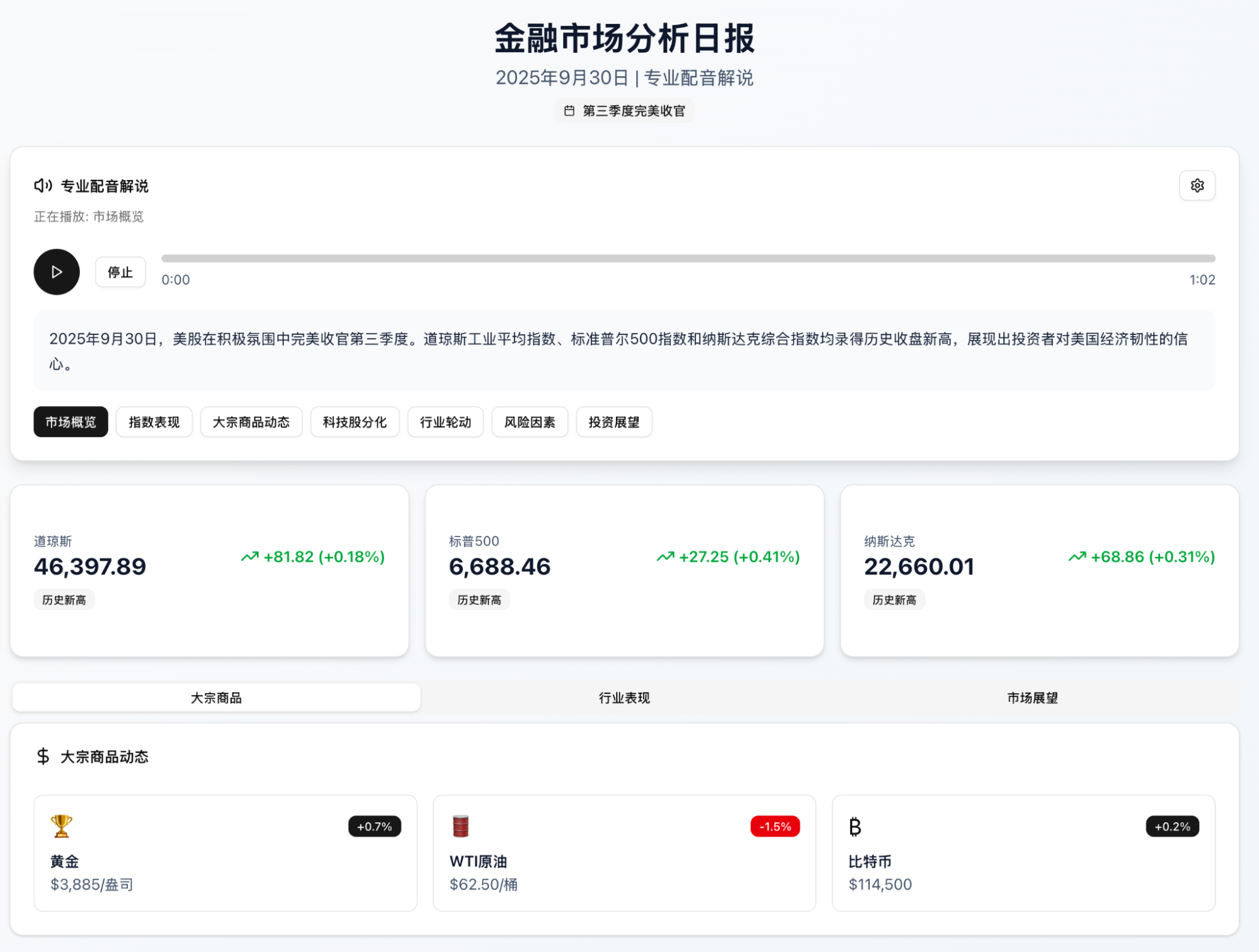

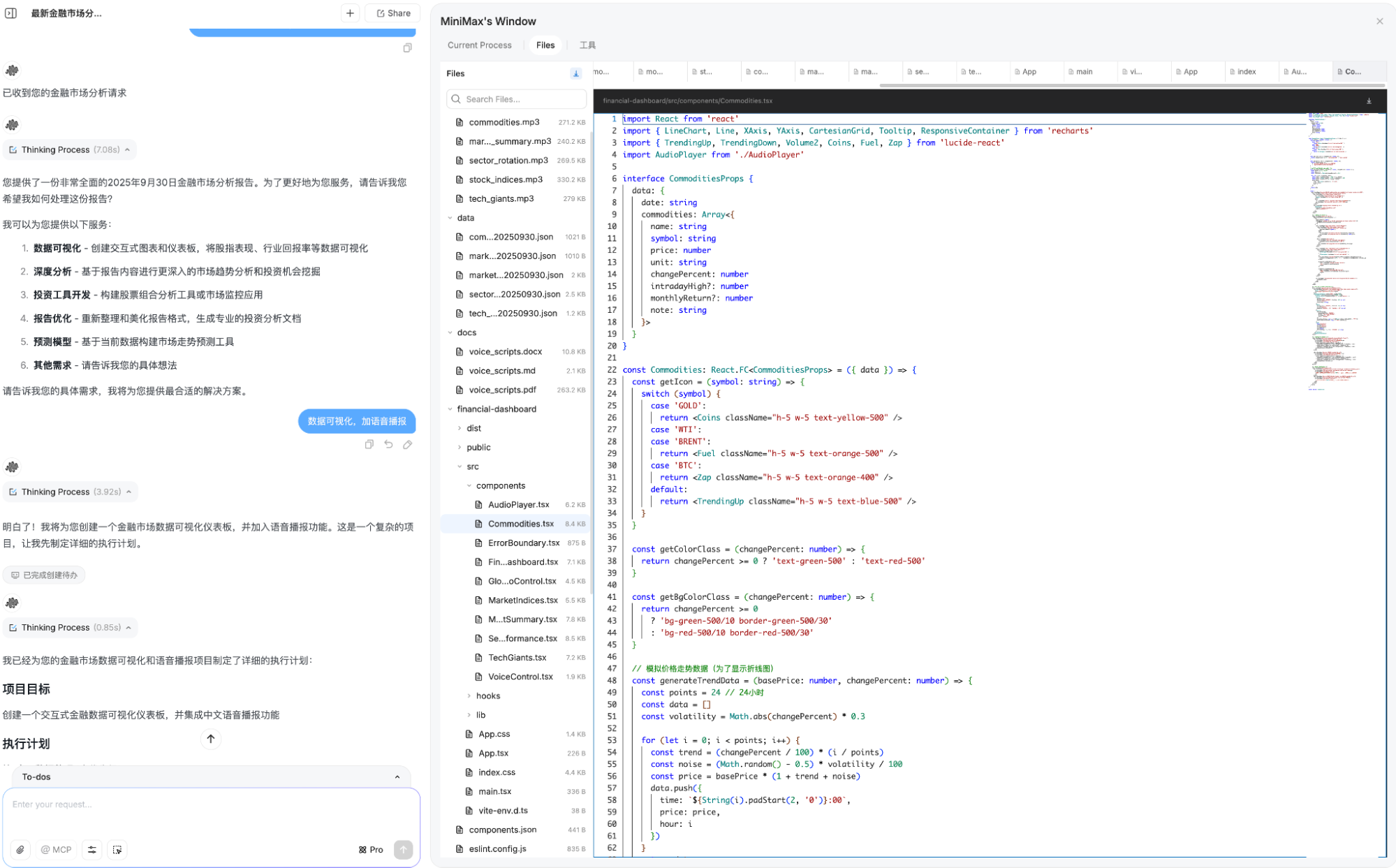

第三个,MiniMax

优点:

唯一一个跟我确认计划的;

内容最丰富;

语音最自然;

缺点:

过度思考,导致“幻觉”很多,比如黄金价格的走势,既然已经写了模拟,那不如不模拟;

页面有点混乱,不清晰;

过于勤奋,搜了一堆插图;

干了超过半小时;

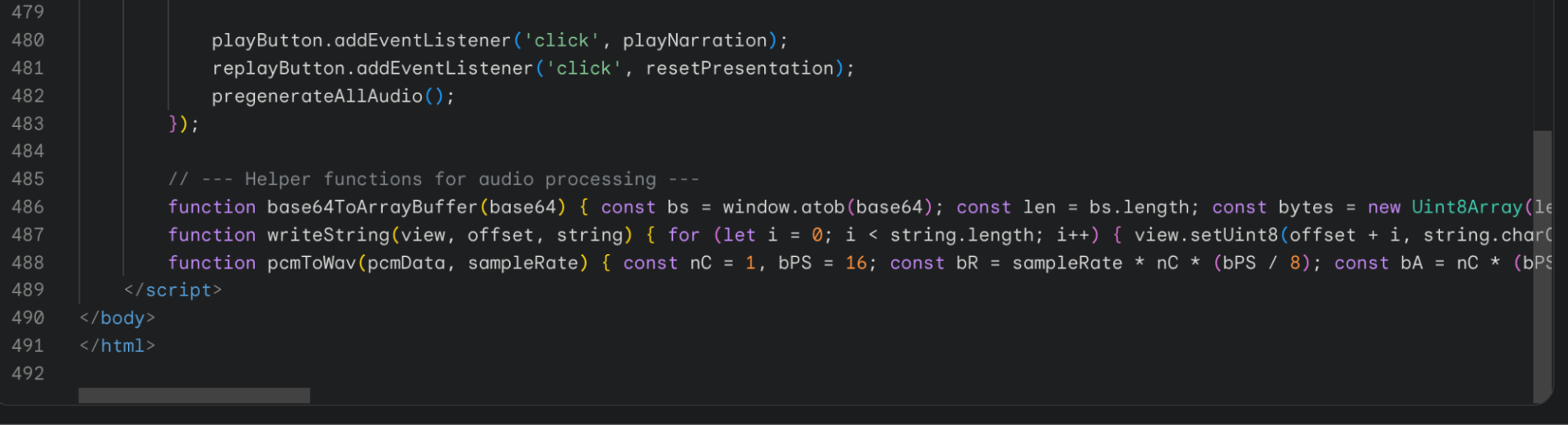

其实,总体而言,三家Agent的结果是超过我预期的。也打开了我一些新的思路,我回过去用在了Gemini的Canvas上(之前也尝试过,但是有一步没处理太好),行了。

直接上传视频如下:

就是一个html文件,不到五百行代码,代码生成加语音生成时间不到五分钟(主要是语音生成时间长一点)。

我把流程又优化了一下,直接在Gemini中预设了一个Gems,这样只需要复制黏贴一次文本报告内容,再用Command+Shift+5录屏就好了。

优点:

内容特别适合视频生成,整篇播报整体性更强;

生成时间端,如果真的考虑生产的话,成本会远远低于上面的三家;

html代码不挑环境,语音生成也是直接通过html代码调用Gemini-2.5-TTS,只要有api-key,哪里都能用;

缺点:如果稳定性欠佳算的话,但是至少比上面三家稳定得多。

以前文章里经常有人会评论:国产模型怎么怎么好,其实这个例子可以看的更清楚一点:

通过在Agent上下巨大的功夫,得到一个看起来好像很实用的结果,这不是AI时代的正途,我们如今理解的AI的发展方向是“原生的智能”;

我承认,在产品化上,国产模型+Agent(不包括Manus,因为只是Agent应用)做的比海外公司多得多,也是我这段时间一直强调的观点:至少百分之八十的场景下这些都可以完成的很好了;

但是因为Agent预设的过多,导致每个环节绑定过深,失去了灵活性,也间接导致了上面说过的OK Computer“傻乎乎”的消耗三次机会,GLM-4.6要在我反复帮助下才交付正确的代码……

会有人反驳,会有人安利什么流程调度,什么n8n,dify。不客气的说,早在五年之前,听过的没听过的流程调度工具 and 解决方案,无论是data pipeline概念,还是MLOPs,我几乎用过了所有,开源的和闭源的。ChatGPT刚问世,全部都在说Chat的时候,我就在讲workflow,用workflow了,甚至为了调度,自己还写了flow工具。Workflow是工程,而不是AI;Workflow是业务,而不是技术,套句流行语,懂的自然懂;

实际上,模型发展到今天,无论是借鉴先进经验,还是自身能力快速提升,国产模型能力是不差的。但是没办法,最好的用户(付费意愿和付费能力最强)已经被三家领先模型占领心智了,在Agent部分调的漂亮一点,讲究“傻瓜化”和“一键直出”是很好的营销点;

可是,也许AI时代最大的“谎言”就是“傻瓜化”和“一键直出”,毫不费力的高质量背后必然是业务层面和技术层面巨大的积累和巧思,靠工程上大量加入预设可以出很好的demo,然后呢?

所以,不是做的少了,而是做的太多了。

回看Gemini,更好更全能的模型,以更省时省钱的方式,产出更符合要求,更稳定的结果。不是每一个三角都叫“不可能三角”的。

最后,我在Day1就用自己生成的结果来“批评”受到过度吹捧的Manus,但事实上我一直挺佩服Manus的想法的,包括我也佩服上面使用的三家国产模型Agent的产品,我到现在还会时不时试一下Manus,很多案例和处理过程能源源不断的给到我启发。

可是,我们面临的可能越来越不是一个“勤能补拙”的时代了。是的,我写下这句话时,心情的底色又是悲的。